🤖 Интеграция ИИ-помощника

Используйте модели, развернутые в Ollama, для обработки результатов распознавания. Вы можете настраивать шаблоны для различных задач.

1. Настройка службы ИИ

Локальная Ollama (рекомендуется, полностью автономно)

- Посетите ollama.com/download, чтобы скачать и установить Ollama.

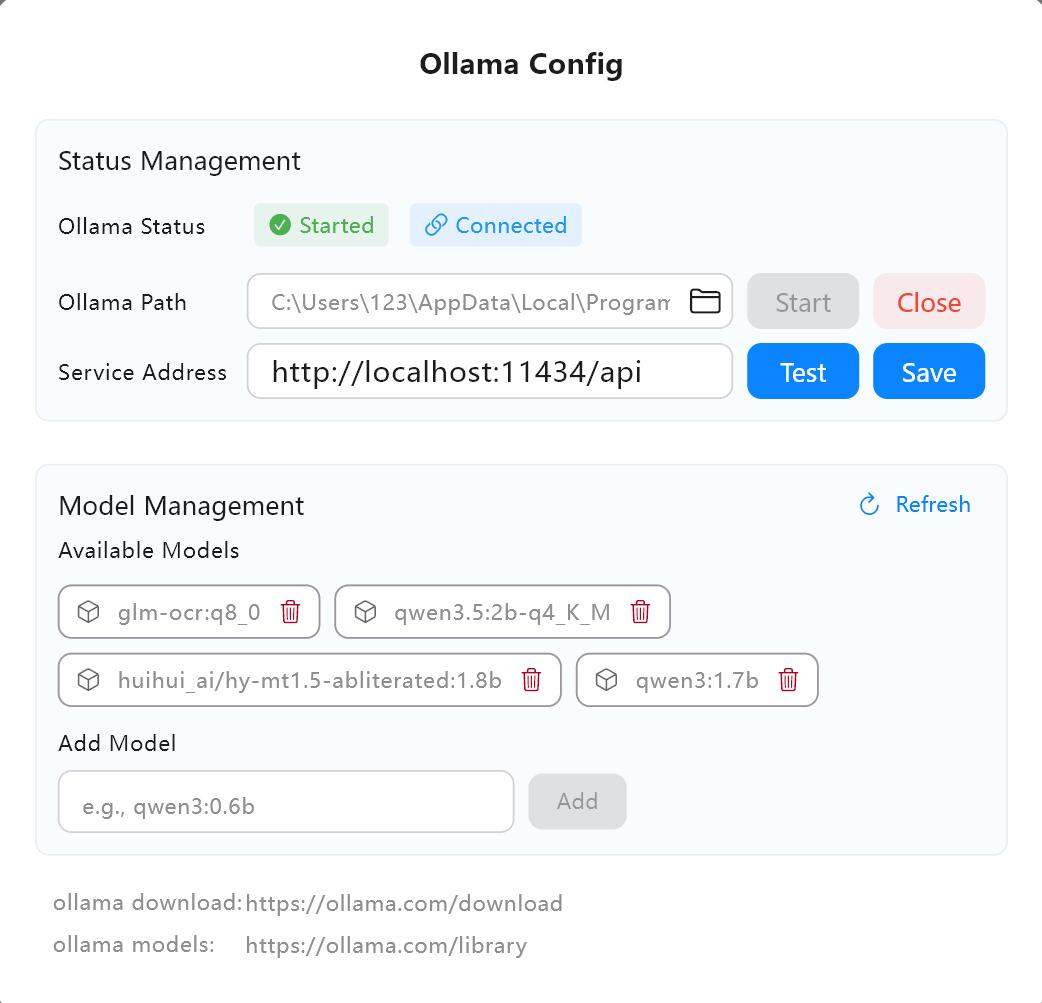

- Проверьте адрес службы в настройках ИИ Owl Meeting (по умолчанию используется

http://localhost:11434/api). - Нажмите «Тест», чтобы подтвердить нормальное соединение.

- Найдите и скачайте необходимую модель (например,

qwen3:4b) в библиотеке моделей Ollama.

Интерфейс настройки службы ИИ

Интерфейс настройки службы ИИ

2. Четыре типа задач

- Перевод: перевод результатов распознавания на другие языки. Вы можете указать исходный язык и целевой язык.

- Коррекция: исправляет опечатки и грамматические ошибки, а также оптимизирует структуру предложений для лучшей плавности.

- Сводка: создание протоколов встреч или сводок контента.

- Пользовательская задача: используйте настраиваемые шаблоны промптов для обработки результатов в соответствии с вашими потребностями (например, извлечение пунктов действий, создание списков дел и т. д.).

3. Три режима ввода

- Одиночный: обработка сегментов по одному. Это единственный режим, доступный при использовании ИИ во время транскрибации в реальном времени.

- Пакетный: объединяет несколько результатов и отправляет их в модель вместе для повышения эффективности. Размер пакета настраивается.

- Полный текст: отправляет все результаты распознавания как полный текст за один раз. Идеально подходит для создания сводок встреч или полных переводов текста.

4. ИИ в реальном времени против офлайн-ИИ

- ИИ в реальном времени: во время процесса транскрибации в реальном времени каждый распознанный сегмент автоматически отправляется в модель для обработки и отображается синхронно. Требуется предварительный запуск ИИ-задачи на боковой панели. Поддерживается только «Одиночный» режим.

- Офлайн-ИИ: обработка завершенных результатов транскрибации на странице деталей истории. Поддерживает режимы «Одиночный», «Пакетный» и «Полный текст».

5. Пользовательские параметры модели

Встроенная конфигурация для общих параметров LLM (например, temperature, top_p). Продвинутые пользователи могут включить панель параметров модели для тонкой настройки или передать пользовательские параметры в формате JSON.

6. Часто задаваемые вопросы (FAQ)

- Q: Не удается подключиться к Ollama?

A: Проверьте, запущен ли Ollama и правильно ли указан адрес службы (по умолчанию:http://localhost:11434/api). - Q: Низкая скорость вывода?

A: Переключитесь на модель с меньшим количеством параметров (например, 1.5B или 4B) или измените режим ввода с «Полный текст» на «Одиночный». - Q: Режим реального времени выдает «Сначала нажмите синюю кнопку»?

A: ИИ-задачи в реальном времени требуют запуска ИИ-движка сначала синей кнопкой на боковой панели.

7. Рекомендуемые модели

- Задачи перевода: рекомендуется HY-MT1.5-1.8B — профессиональная модель перевода, поддерживающая несколько языков с очень высокой скоростью вывода.

- Общие задачи: рекомендуется серия Qwen3 (например, 4B или 8B), обладающая отличными способностями к пониманию.