🤖 Інтеграція AI-помічника

Використовуйте моделі, розгорнуті в Ollama, для обробки результатів розпізнавання. Ви можете створювати власні шаблони для різних завдань.

1. Налаштування служби ШІ

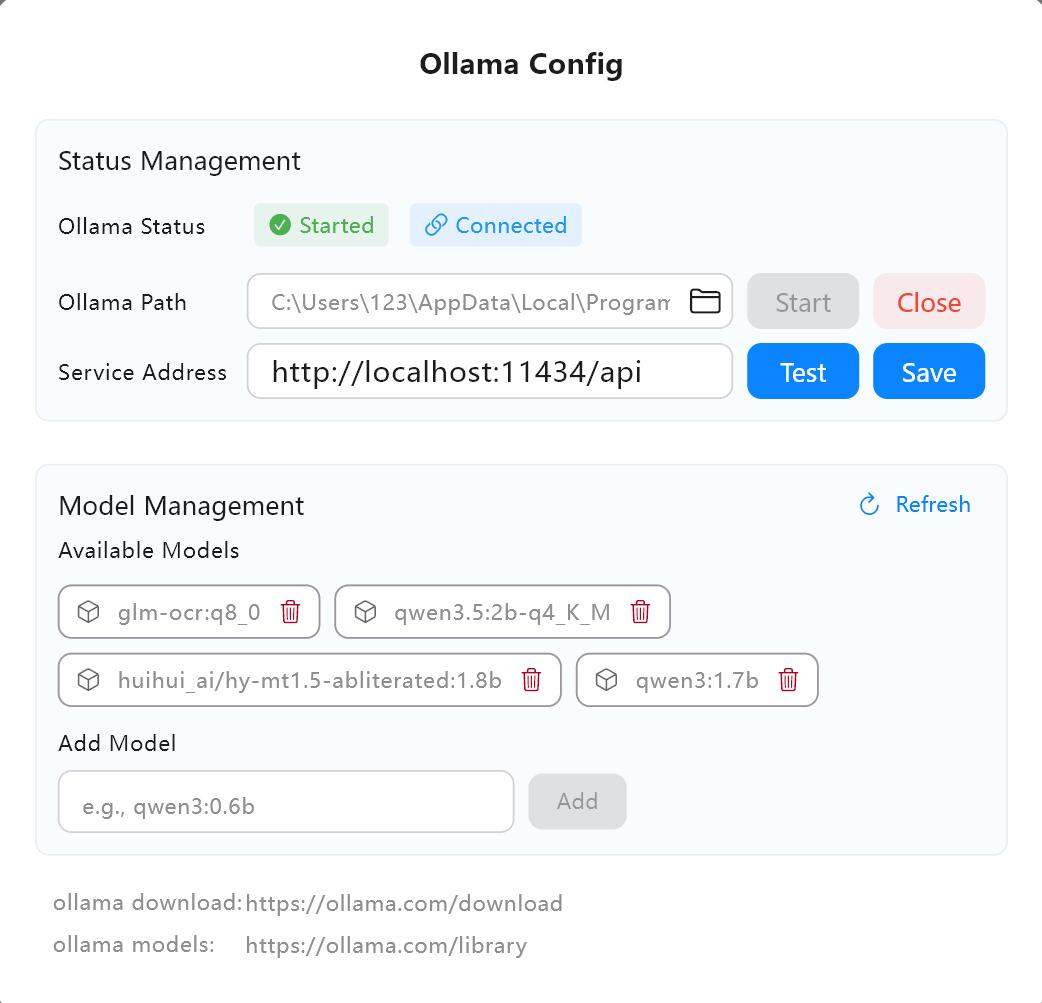

Локальна Ollama (рекомендовано, повністю офлайн)

- Відвідайте ollama.com/download, щоб завантажити та встановити Ollama.

- Перевірте адресу сервісу в налаштуваннях ШІ Owl Meeting (за замовчуванням використовується

http://localhost:11434/api). - Натисніть «Тест», щоб підтвердити нормальне з'єднання.

- Знайдіть та завантажте необхідну модель (наприклад,

qwen3:4b) у бібліотеці моделей Ollama.

Інтерфейс налаштування служби штучного інтелекту

Інтерфейс налаштування служби штучного інтелекту

2. Чотири типи завдань

- Переклад: переклад результатів розпізнавання на інші мови. Ви можете вказати вихідну мову та цільову мову.

- Корекція: виправляє друкарські помилки та граматичні помилки, а также оптимізує структуру речень для кращої плинності.

- Підсумок: створення протоколів зустрічей або підсумків контенту.

- Спеціальне: використовуйте настроювані шаблони промптів для обробки результатів відповідно до ваших потреб (наприклад, вилучення пунктів дій, створення списків справ тощо).

3. Три режими введення

- Окремий: обробка сегментів один за одним. Це єдиний режим, доступний при використанні ШІ під час транскрипції в реальному часі.

- Пакетний: об'єднує кілька результатів і відправляє їх у модель разом для підвищення ефективності. Розмір пакета налаштовується.

- Повний текст: відправляє всі результати розпізнавання як повний текст за один раз. Ідеально підходить для створення підсумків зустрічей або повних перекладів тексту.

4. ШІ в реальному часі проти офлайн-ШІ

- ШІ в реальному часі: під час процесу транскрипції в реальному часі кожен розпізнаний сегмент автоматично відправляється в модель для обробки та відображається синхронно. Потрібен попередній запуск ШІ-завдання на бічній панелі. Підтримується тільки режим «Окремий».

- Офлайн-ШІ: обробка завершених результатів транскрипції на сторінці деталей історії. Підтримує режими «Окремий», «Пакетний» та «Повний текст».

5. Користувацькі параметри моделі

Вбудована конфігурація для загальних параметрів LLM (наприклад, temperature, top_p). Просунуті користувачі можуть увімкнути панель параметрів моделі для тонкого налаштування або передати користувацькі параметри у форматі JSON.

6. Часто задавані питання (FAQ)

- Q: Не вдається підключитися до Ollama?

A: Перевірте, чи запущено Ollama та чи правильно вказано адресу служби (за замовчуванням:http://localhost:11434/api). - Q: Низька швидкість виводу?

A: Переключіться на модель із меншою кількістю параметрів (наприклад, 1.5B або 4B) или змініть режим введення з «Повний текст» на «Окремий». - Q: Режим реального часу видає «Спочатку натисніть синю кнопку»?

A: ШІ-завдання в реальному часі вимагають запуску ШІ-двигуна спочатку синьою кнопкою на бічній панелі.

7. Рекомендовані моделі

- Завдання перекладу: рекомендовано HY-MT1.5-1.8B — професійна модель перекладу, що підтримує кілька мов із надзвичайно високою швидкістю виводу.

- Загальні завдання: рекомендована серія Qwen3 (наприклад, 4B або 8B), що володіє чудовими здібностями до розуміння.