AI 助手集成

Owl Meeting 可以调用大语言模型(LLM)对识别结果进行二次处理——翻译、纠错、总结、自定义任务均可。支持本地部署的 Ollama 以及任何兼容 OpenAI API 的第三方服务。

1. 配置 AI 服务

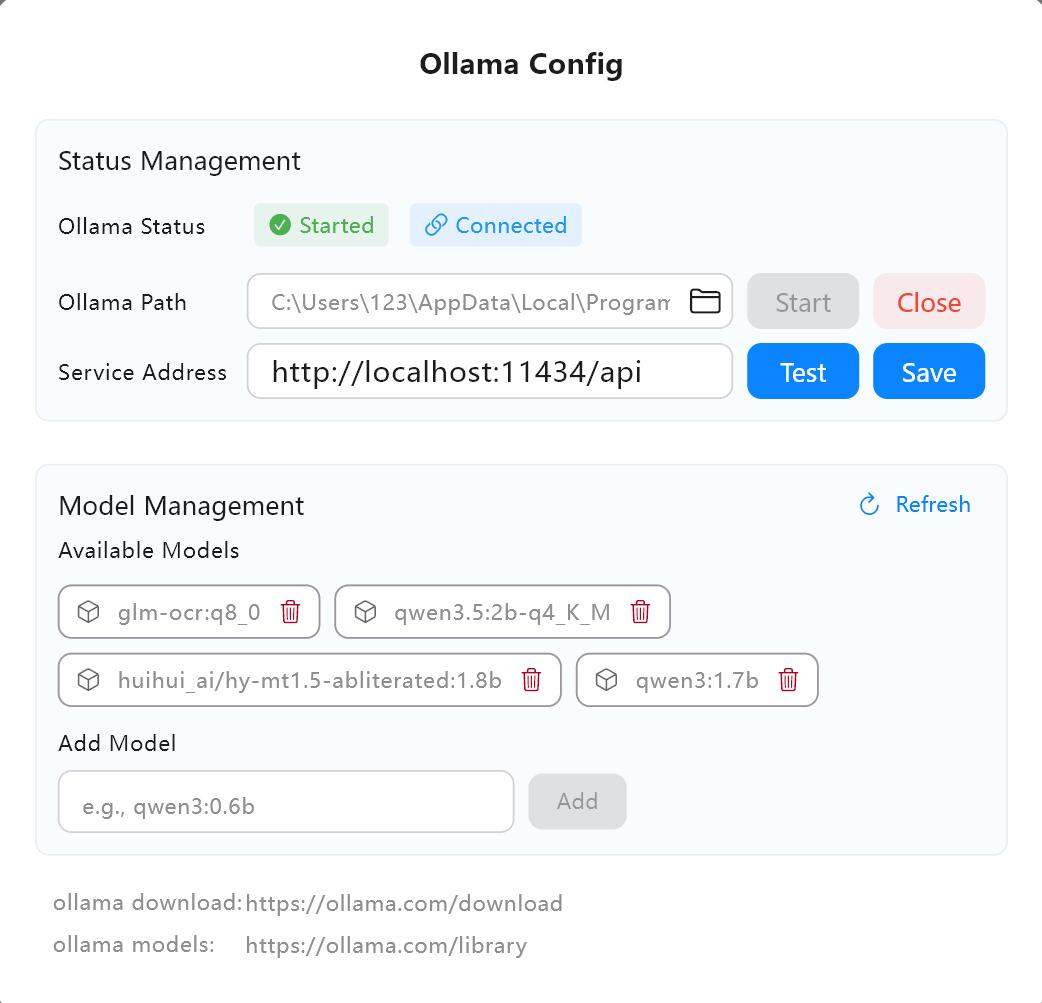

本地 Ollama(推荐,完全离线)

- 访问 ollama.com/download 下载并安装 Ollama。

- 在 Owl Meeting 的 AI 设置中确认服务地址(默认

http://localhost:11434/api)。 - 点击"测试"确认连接正常。

- 在 Ollama 模型库 中搜索并拉取所需模型(如

qwen3:4b)。

AI 服务配置界面

AI 服务配置界面

2. 四种任务类型

- 翻译:将识别结果翻译成其他语言。可指定源语言和目标语言。

- 纠错:纠正文中的错别字、语法错误,并可优化句子结构使其更流畅。

- 总结:生成会议纪要或内容摘要。

- 自定义:编写自定义 Prompt 模板,让模型按您的需求处理识别结果(如提取行动项、生成 To-do 列表等)。

3. 三种输入模式

- 逐条:一条识别结果调用一次模型。实时识别中使用 AI 时只能选择此模式。

- 批量:将多条结果合并后一起发送给模型处理,效率更高。可自定义每批的数量。

- 全文:将所有识别结果作为完整文本一次性发送。适合生成会议总结、整篇翻译等场景。

4. 实时 AI 与离线 AI

- 实时 AI:在实时转写过程中,每识别出一条结果就自动发送给模型处理,结果同步显示。需要先在侧边栏启动 AI 任务。仅支持"逐条"模式。

- 离线 AI:在历史详情页对已完成的转写结果进行 AI 处理。支持逐条、批量、全文三种模式。

5. 自定义模型参数

内置了大语言模型常用的参数配置(如 temperature、top_p 等)。如果您是进阶用户,可以开启模型参数面板进行精细调整,也支持通过 JSON 格式传入自定义参数。

6. 常见问题

- Q: 连不上 Ollama?

A: 检查 Ollama 是否在运行,以及服务地址是否正确。默认地址为http://localhost:11434/api。 - Q: 输出结果太慢?

A: 换用参数量更小的模型(如 4B 或 1.8B),或将输入模式从"全文"改为"逐条"。 - Q: 实时转写时提示"请先点击上方蓝色按钮"?

A: 实时 AI 任务需要先在侧边栏点击蓝色按钮启动 AI 引擎,然后才能开始处理。

7. 推荐模型

- 翻译任务:推荐 HY-MT1.5-1.8B——一款专业的翻译模型,支持多种语言,推理速度极快。

- 通用任务:推荐 Qwen3 系列(如 4B 或 8B),中文理解能力出色。