🤖 Integrazione Assistente AI

Utilizza i modelli distribuiti in Ollama per elaborare i risultati del riconoscimento. Puoi personalizzare i modelli per gestire vari task.

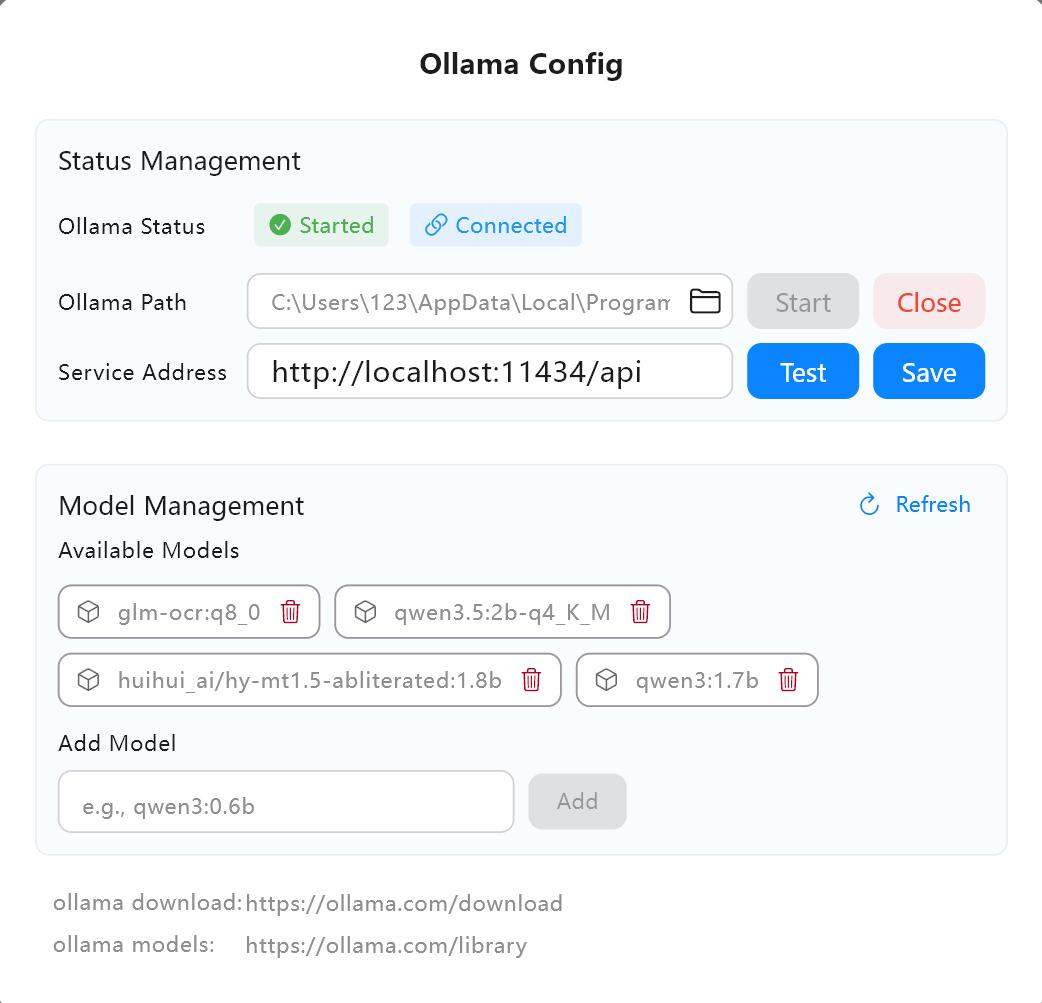

1. Configura il servizio AI

Ollama locale (consigliato, completamente offline)

- Visita ollama.com/download per scaricare e installare Ollama.

- Verifica l'indirizzo del servizio nelle impostazioni AI di Owl Meeting (il valore predefinito è

http://localhost:11434/api). - Fai clic su "Test" per confermare che la connessione sia normale.

- Cerca e scarica il modello richiesto (ad esempio,

qwen3:4b) nella libreria di modelli Ollama.

Interfaccia di configurazione del servizio AI

Interfaccia di configurazione del servizio AI

2. Quattro tipi di attività

- Traduzione: Traduce i risultati del riconoscimento in altre lingue. È possibile specificare la lingua di origine e quella di destinazione.

- Correzione: Corregge refusi ed errori grammaticali e ottimizza la struttura delle frasi per una migliore fluidità.

- Riepilogo: Genera verbali di riunione o riepiloghi dei contenuti.

- Personalizzato: Utilizza modelli di prompt personalizzati per elaborare i risultati in base alle tue esigenze (ad esempio, estrazione di punti d'azione, generazione di elenchi To-do, ecc.).

3. Tre modalità di input

- Singolo: Elabora i segmenti uno per uno. Questa è l'unica modalità disponibile quando si utilizza l'AI durante la trascrizione in tempo reale.

- Batch: Unisce più risultati e li invia al modello insieme per una maggiore efficienza. La dimensione del batch è personalizzabile.

- Testo completo: Invia tutti i risultati del riconoscimento come un testo completo in una sola volta. Ideale per generare riepiloghi di riunioni o traduzioni integrali.

4. AI in tempo reale vs. AI offline

- AI in tempo reale: Durante il processo di trascrizione in tempo reale, ogni segmento riconosciuto viene inviato automaticamente al modello per l'elaborazione e visualizzato in modo sincrono. Richiede l'avvio preventivo dell'attività AI nella barra laterale. È supportata solo la modalità "Singolo".

- AI offline: Elabora i risultati della trascrizione completati nella pagina dei dettagli della cronologia. Supporta le modalità "Singolo", "Batch" e "Testo completo".

5. Parametri del modello personalizzati

Configurazione integrata per i parametri comuni dei LLM (ad esempio, temperatura, top_p). Gli utenti esperti possono abilitare il pannello dei parametri del modello per la messa a punto o passare parametri personalizzati in formato JSON.

6. Domande frequenti (FAQ)

- Q: Impossibile connettersi a Ollama?

A: Verifica se Ollama è in esecuzione e se l'indirizzo del servizio è corretto (predefinito:http://localhost:11434/api). - Q: Velocità di output lenta?

A: Passa a un modello con meno parametri (ad esempio, 1.5B o 4B) oppure cambia la modalità di input da "Testo completo" a "Singolo". - Q: La modalità in tempo reale indica "Fare clic prima sul pulsante blu"?

A: Le attività AI in tempo reale richiedono l'avvio del motore AI facendo clic prima sul pulsante blu nella barra laterale.

7. Modelli consigliati

- Attività di traduzione: Consigliato HY-MT1.5-1.8B — un modello di traduzione professionale che supporta più lingue con una velocità di inferenza molto elevata.

- Attività generali: Consigliata la serie Qwen3 (ad esempio, 4B o 8B), che ha eccellenti capacità di comprensione.