🤖 AI-assistent integratie

Maak gebruik van in Ollama geïnstalleerde modellen om herkenningsresultaten te verwerken. Gebruik aangepaste sjablonen voor diverse taken.

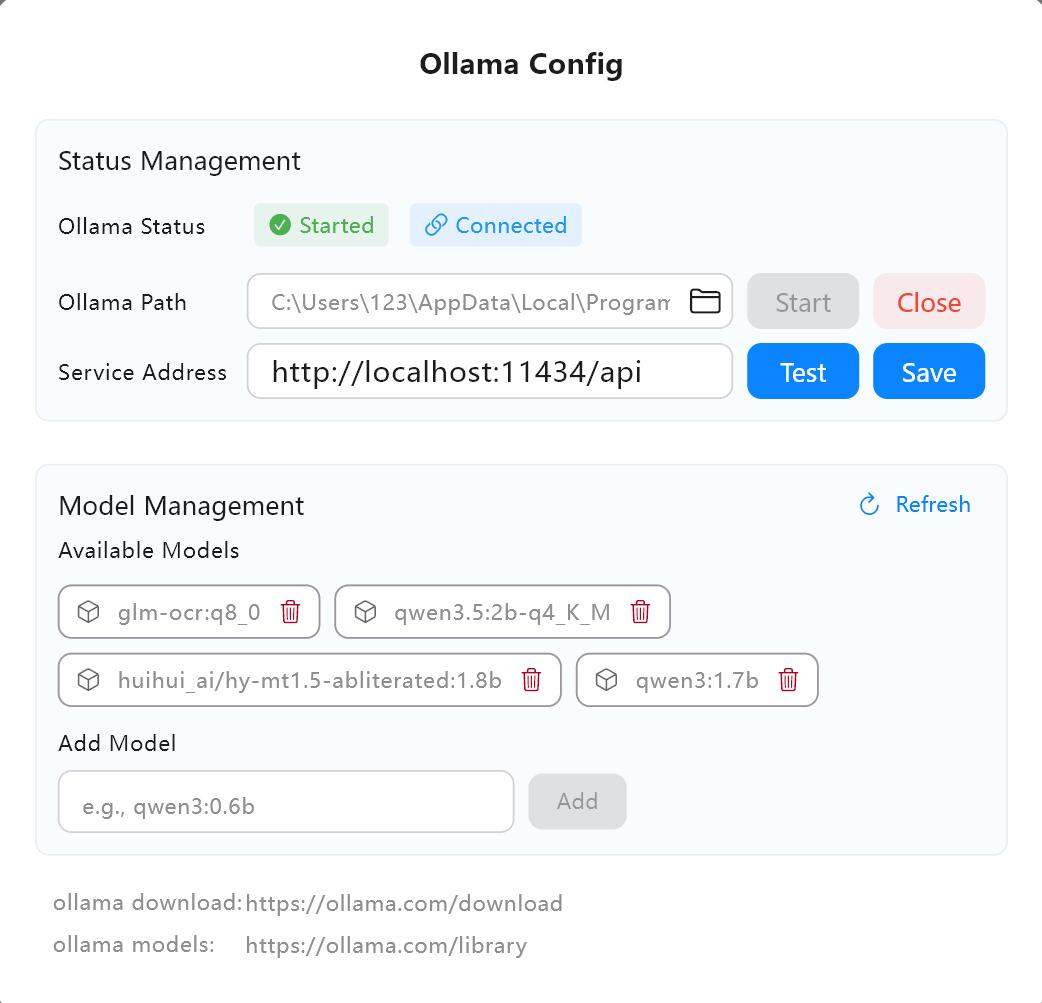

1. AI-service configureren

Lokale Ollama (aanbevolen, volledig offline)

- Bezoek ollama.com/download om Ollama te downloaden en te installeren.

- Controleer het serviceadres in de AI-instellingen van Owl Meeting (standaard is

http://localhost:11434/api). - Klik op "Testen" om te bevestigen dat de verbinding normaal is.

- Zoek en download het gewenste model (bijv.

qwen3:4b) in de Ollama modelbibliotheek.

Configuratie-interface voor AI-services

Configuratie-interface voor AI-services

2. Vier soorten taken

- Vertaling: Vertaal herkenningsresultaten naar andere talen. U kunt de brontaal en de doeltaal opgeven.

- Correctie: Corrigeert typefouten en grammaticafouten, en optimaliseert de zinsstructuur voor een betere leesbaarheid.

- Samenvatting: Genereert notulen of inhoudelijke samenvattingen van vergaderingen.

- Aangepast: Gebruik aangepaste prompt-sjablonen om resultaten te verwerken volgens uw behoeften (bijv. het extraheren van actiepunten, het genereren van takenlijsten, enz.).

3. Drie invoermodi

- Individueel: Verwerkt segmenten één voor één. Dit is de enige modus die beschikbaar is bij het gebruik van AI tijdens realtime transcriptie.

- Batch: Combineert meerdere resultaten en stuurt ze samen naar het model voor een hogere efficiëntie. De batchgrootte is aanpasbaar.

- Volledige tekst: Stuurt alle herkenningsresultaten in één keer als een volledige tekst. Ideaal voor het genereren van vergadersamenvattingen of volledige tekstvertalingen.

4. Real-time AI vs. Offline AI

- Real-time AI: Tijdens het realtime transcriptieproces wordt elk herkend segment automatisch naar het model gestuurd voor verwerking en synchroon weergegeven. Vereist dat de AI-taak eerst in de zijbalk wordt gestart. Alleen de modus "Individueel" wordt ondersteund.

- Offline AI: Verwerkt voltooide transcriptieresultaten op de pagina met geschiedenisdetails. Ondersteunt de modi "Individueel", "Batch" en "Volledige tekst".

5. Aangepaste modelparameters

Ingebouwde configuratie voor veelvoorkomende LLM-parameters (bijv. temperatuur, top_p). Geavanceerde gebruikers kunnen het modelparameterpaneel inschakelen voor fijnafstemming of aangepaste parameters in JSON-formaat doorgeven.

6. Veelgestelde vragen (FAQ)

- Q: Kan geen verbinding maken met Ollama?

A: Controleer of Ollama draait en of het serviceadres correct is (standaard:http://localhost:11434/api). - Q: Lage uitvoersnelheid?

A: Schakel over naar een model met minder parameters (bijv. 1.5B of 4B), of wijzig de invoermodus van "Volledige tekst" naar "Individueel". - Q: Real-time modus zegt "Klik eerst op de blauwe knop"?

A: Real-time AI-taken vereisen dat de AI-engine eerst wordt gestart door op de blauwe knop in de zijbalk te klikken.

7. Aanbevolen modellen

- Vertalingstaken: Aanbevolen HY-MT1.5-1.8B — een professioneel vertaalmodel dat meerdere talen ondersteunt met een zeer hoge verwerkingssnelheid.

- Algemene taken: Aanbevolen Qwen3-serie (bijv. 4B of 8B), die uitstekende begripsmogelijkheden heeft.